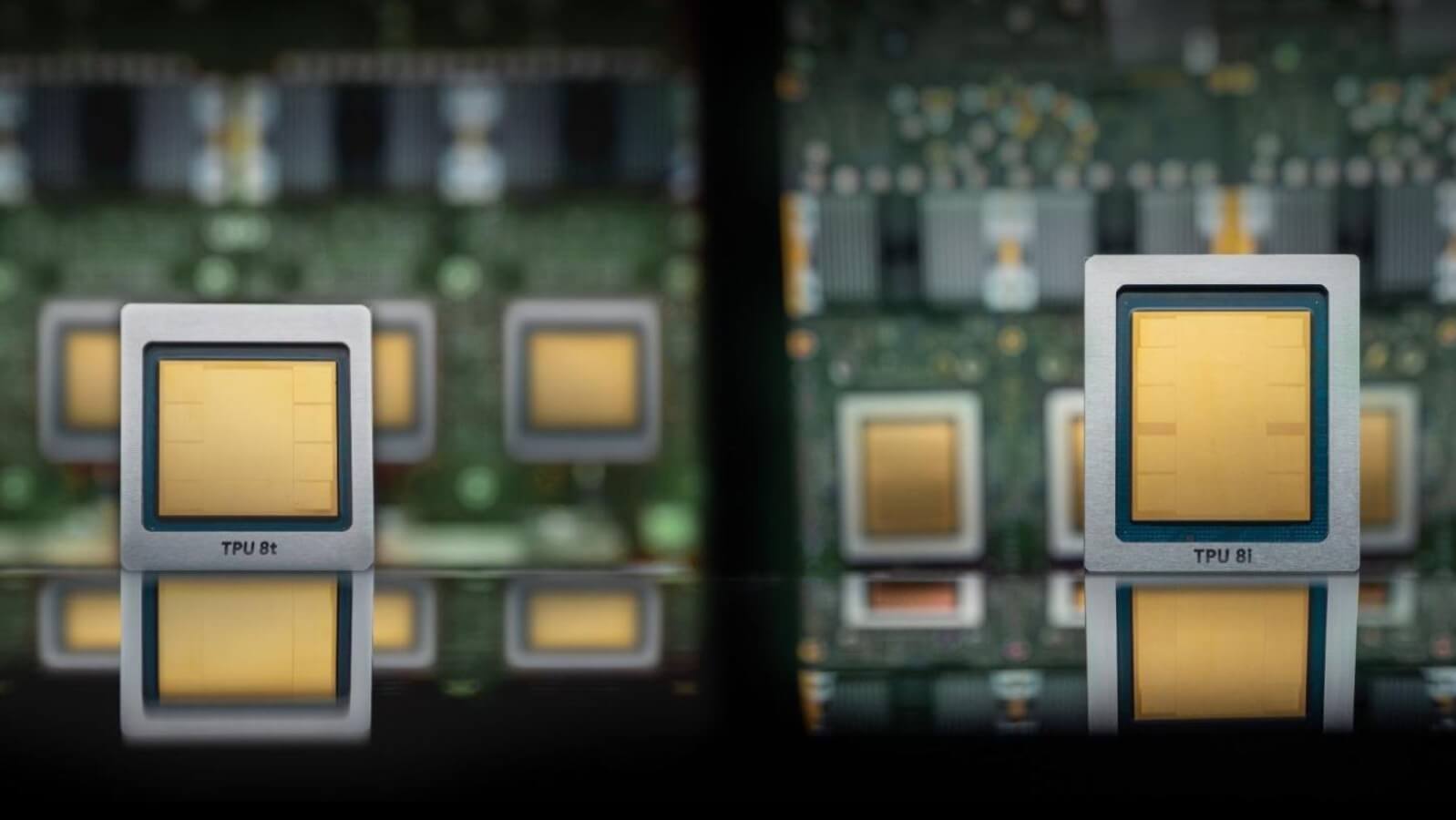

Google Cloud anunció el 22 de abril que su octava generación de chips de inteligencia artificial (AI) personalizados, o unidades de procesamiento de tensores (TPU), se dividirá en dos.

Un chip, llamado TPU 8t, está diseñado para el entrenamiento de modelos y el otro, el TPU 8i, para la inferencia. Ambos estarán disponibles a finales de este año.

La inferencia es la ejecución de los modelos; es decir, lo que sucede después de que los usuarios envían sus datos.

Google denomina a estos chips TPU, y no GPU, porque sus chips personalizados de bajo consumo se llamaban originalmente Tensor.

“Con el auge de la AI agéntica, determinamos que la comunidad se beneficiaría de chips especializados individualmente para las necesidades de entrenamiento y servicio”»”, declaró el vicepresidente sénior y CTO de AI e infraestructura de Google, Amin Vahdat, en una publicación de blog.

La compañía destaca mejoras en las especificaciones de rendimiento para estas nuevas TPU en comparación con las generaciones anteriores: entrenamiento de modelos de AI hasta tres veces más rápido, un 80% de mejor relación rendimiento-costo y la capacidad de interconectar más de un millón de TPU en un solo clúster.

El resultado debería ser mucha más capacidad de procesamiento con un menor consumo energético —y costos reducidos para los clientes— que las versiones anteriores.

Google no dejará Nvidia del todo

Pero los chips de Google no representan un ataque frontal al futuro de Nvidia, al menos no por ahora. Al igual que otros hiperescaladores, como Microsoft y Amazon, Google utiliza estos chips para complementar los sistemas basados en Nvidia que ofrece en su infraestructura.

La compañía no está reemplazando directamente a Nvidia. De hecho, Google promete que su nube contará con el último chip de Nvidia, Vera Rubin, a finales de 2026.

Es posible que, en el futuro, los hiperescaladores que desarrollan sus propios chips de AI (Amazon, Microsoft y Google) necesiten menos a Nvidia, a medida que las empresas trasladen sus necesidades de AI a sus nubes y adapten sus aplicaciones a estos chips.

Sin embargo, en la situación actual, no es rentable apostar en contra de Nvidia. Como comentó en tono de broma el reconocido analista del mercado de chips Patrick Moorhead en X, predijo en 2016, cuando el gigante de las búsquedas lanzó su primera TPU, que la TPU de Google podría ser una mala noticia para Nvidia (e Intel). Nvidia es ahora una empresa con una capitalización de mercado de casi $5 billones, lo que significa que aquella predicción no se ha cumplido.

Si todo sale según lo planeado por Nvidia, el crecimiento de Google como proveedor de servicios en la nube para AI se traduciría en más negocio para el fabricante de chips, no en menos, incluso si muchas cargas de trabajo se ejecutan en chips de Google.

De hecho, Google también afirma haber acordado colaborar con Nvidia para diseñar redes informáticas que permitan a los sistemas basados en Nvidia funcionar de forma aún más eficiente en su nube. En concreto, ambos gigantes tecnológicos están trabajando para mejorar la tecnología de red basada en software llamada Falcon, que Google creó y publicó como código abierto en 2023 bajo el auspicio del Open Compute Project, la organización pionera en hardware de centros de datos de código abierto.